北京大学王选计算机研究所VDIG实验室成员参加ECCV2024

2024年9月28日至10月4日,欧洲计算机视觉会议(18th European Conference on Computer Vision)ECCV 2024在意大利米兰举行。ECCV是计算机视觉领域的顶级会议之一,与CVPR和ICCV并列为计算机视觉领域的三大国际顶级学术会议。ECCV 2024在全球范围内吸引了广泛关注,共收到8585篇有效投稿,经过严格评审,共有2395篇文章被正会录用,录用率为27.9%

ECCV 2024主会场

北京大学王选计算机研究所VDIG实验室发表的《HENet: Hybrid Encoding for End-to-end Multi-task 3D Perception from Multi-view Cameras》被本届ECCV录用。

实验室博士生夏仲禹作海报展示

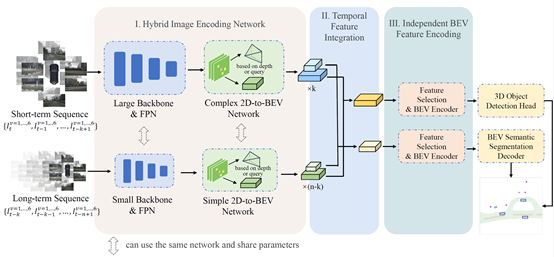

该论文聚焦包括三维目标检测和鸟瞰图(BEV)语义分割等任务在内的多任务三维感知算法。三维感知算法在自动驾驶、智能机器人等领域都有着较为广泛的应用价值。但三维感知任务的模型训练代价较高,长视频时序、高输入分辨率和较大的神经网络编码器不可兼得。对于时序特征图中的运动物体,全局卷积或注意力机制会引入更多噪声。与此同时,三维感知模型中90%以上的计算代价都来自于编码器,因此使用一个共享的编码器进行编码,后挂多个任务的解码器进行解码,能够大幅减少多任务感知的计算代价,但是过去的研究发现端到端多任务中存在冲突,导致多任务模型精度弱于单任务模型。

针对以上问题,团队提出混合长短时序的特征编码网络,针对长时序采用小参数量的高效率编码网络,针对短时序采用大参数量的高精度编码网络,能够动态地调整网络推理速度与精度,并且能够提高在同样计算量下的网络性能。利用基于注意力机制的时序融合方法,能够针对上述不同编码网络得到的多帧BEV特征图进行时序融合,对于动态物体能够更好地进行跨帧对齐。最后,通过对不同任务之间的冲突进行分析,该研究发现不同任务对特征的尺度与分布有着不同的要求,团队针对该问题提出了一种解决方案,即通过长短时序混合编码,生成多尺度的BEV特征,进行时序和跨模态融合后,保留多尺度特征,经过特征选择,分别给予各任务解码器不同尺度的特征图。该方法能够以更低的训练代价和推理代价,训练得到优于已有最先进模型的三维感知多任务模型。

HENet方法介绍

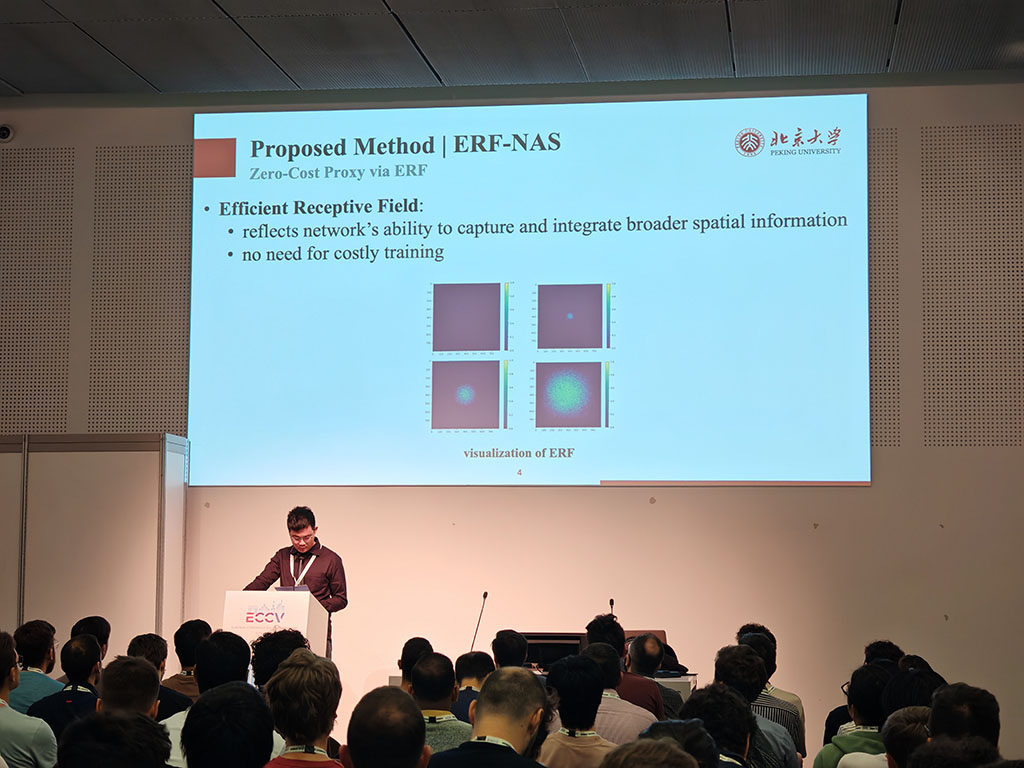

VDIG团队发表的《ERF-NAS: Efficient Receptive Field-based Zero-Shot NAS for Object Detection》被本届ECCV Workshop录用。实验室团队受邀出席了NVIDIA组织的CADL(Computational Aspects of Deep Learning)研讨会并作口头报告。在报告中,详细介绍了本次发表的论文ERF-NAS的相关技术细节和对本领域的帮助。

实验室成员在CADL研讨会上作口头报告

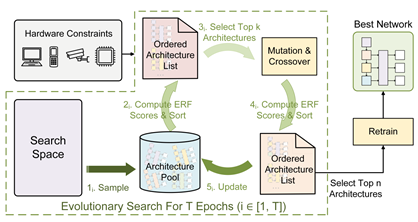

该论文针对神经架构搜索 (NAS) 技术搜索代价大、需要大量计算资源来训练大量候选架构或庞大的超集的问题,提出了基于高效感受野概念的 ERF-NAS,减轻了计算负担。ERF 指标反映了网络从更广泛的空间环境中捕获信息的能力,它可以通过一次前向传递计算出来,无需昂贵的训练,这使得架构搜索过程更快速、更高效。ERF-NAS 方法遵循基于进化搜索策略的流水线:首先从预定义的搜索空间中抽取候选架构并评估它们的 ERF 分数;表现最佳的架构经过变异和交叉操作以生成新的候选;在重复几个周期后,搜索到的最佳架构最终被重新训练为表现最佳的模型。

在 MS COCO 数据集上进行的实验表明,通过ERF-NAS自动化构建的模型,其速度-精度平衡优于 YOLOv8 等最先进的手工设计模型。该方法以更少的参数和计算量实现了更优的准确度。

ERF-NAS方法介绍

会议期间,多场研讨会、领域进展报告和挑战赛精彩纷呈,为参会者提供了丰富的学术交流和展示机会。来自世界各地的专家学者分享了他们在三维重建与新视角合成、广义类别发现、视觉目标跟踪与分割等领域的最新研究成果,展示了计算机视觉技术的最新进展。许多科技巨头及新兴的初创企业,也对计算机视觉、人工智能和机器学习领域的卓越研究成果和产品进行了展示。

Unitree的四足轮式机械狗 (2) Meta展台 (3) Google展台

通过参加ECCV 2024,同学们了解了当前计算机视觉领域的最新科研进展,并且在与工业界的交流中了解了实际应用中的需求和挑战,为实验室成员提供了宝贵的灵感和思路。

上一篇 下一篇